La inteligencia artificial, también conocida por sus siglas IA, es una implementación tecnológica que es capaz de razonar, aprender, tomar decisiones y hasta automejorar, atributos que pueden ser muy relevantes en la implementación de ciberseguridad de las empresas.

Desde el 2020, las IA han evolucionado con rapidez y cada vez son más utilizadas en diferentes campos. Las empresas, por ejemplo, hacen uso de ellas para automatizar y eficientar sus tareas y procesos.

La inteligencia artificial se ha incorporado a las soluciones de ciberseguridad, lo cual contribuye a fortalecerla y hace que las empresas sean más resilientes. A continuación revisaremos los impactos que ha tenido su uso.

IA en la ciberseguridad

La IA, desde su enfoque de aprendizaje, autoadaptibilidad y toma de decisiones efectivas, tiene un gran potencial para lidiar con las amenazas de ciberseguridad que enfrentan las empresas. Puede contribuir de manera sólida mediante diversas estrategias automatizadas que enumeramos a continuación.

1. Detección y prevención de ataques cibernéticos

Con el uso de inteligencia artificial en la ciberseguridad, las empresas pueden detectar y prevenir ataques a sus sistemas de información sensible al instante.

Los sistemas de protección de IA en las empresas se llaman EDR (endpoint detection and response), y a través de sus algoritmos, analizan el comportamiento del sistema y los usuarios, siendo capaces de reconocer patrones inusuales o actividades anómalas, y detectar malware, ataques prompt (manipulación maliciosa por medio de texto) y fraude.

La IA en la ciberseguridad puede incluso realizar evaluación de identidades a través del comportamiento biométrico, que incluye identificación de voz e imagen.

Esta detección y prevención, incluso, podría complementarse con la estrategia organizacional Confianza Cero (zero trust), pues cuando la IA analiza el tráfico e identifica comportamientos irregulares, la verificación de seguridad resulta más sencilla y confiable.

2. Análisis de vulnerabilidades

La IA en la ciberseguridad tiene la labor de aprender del entorno que protege, y por lo tanto revisar las carencias que lo ponen en riesgo, para así poder lidiar con las amenazas.

Su aprendizaje automático le permite escanear datos y patrones para identificar vulnerabilidades, como configuraciones erróneas o fallas en los sistemas de protección.

Conociendo lo que debilita la superficie, las organizaciones pueden tomar medidas proactivas para mitigar los riesgos.

3. Respuesta a incidentes

Cuando un incidente ya está ocurriendo, la IA en la ciberseguridad toma medidas para contener y mitigar, notifica a los encargados de lo que está sucediendo, instala parches y, en la medida de lo posible, aísla sistemas comprometidos de aquellos que aún están a salvo.

Después, la IA puede ser de ayuda para que la empresa pueda recuperarse más fácilmente. Por medio de un análisis de afectaciones, contribuye a que la víctima del ciberataque identifique los daños causados e incluso colabora para remediarlos.

Finalmente, la IA puede aprender del incidente y forjar resiliencia para prevenir ataques futuros.

Ciberataques con IA

Si bien la inteligencia artificial ha traído muchos beneficios para las empresas, y por supuesto para la ciberseguridad, también presenta una oportunidad que está siendo aprovechada por los ciberdelincuentes para cometer sus crímenes.

Los ciberataques han sido estudiados y comprendidos por los expertos de la ciberseguridad, lo cual contribuye a que se puedan tomar medidas para prevenirlos, sin embargo, continuamente están surgiendo nuevas formas de penetrar los sistemas informáticos que incluyen a la IA en su fórmula.

Existen diferentes métodos que usan los ciberdelincuentes para que sus ataques sean, ahora, más efectivos y sofisticados. En seguida lo explicaremos a detalle.

Malwares inteligentes

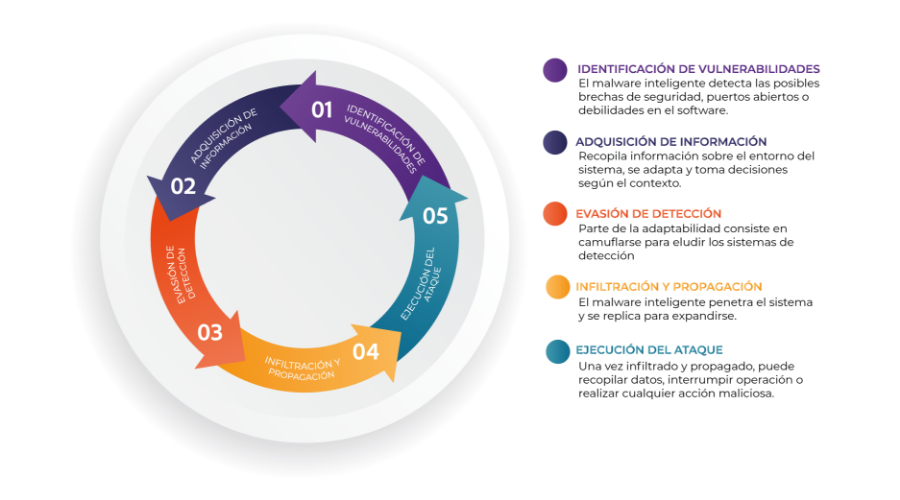

Al igual que la IA en la ciberseguridad, los malwares inteligentes pueden aprender de las vulnerabilidades del sistema y detectar las protecciones menos fortalecidas. La diferencia es que estos buscan aprovecharlas para atacar.

En otras palabras, estos softwares maliciosos inteligentes están diseñados para evadir la seguridad de los sistemas y poder atacar efectivamente, tienen la capacidad de pasar desapercibidos, adaptarse al entorno y eludir las contramedidas y defensas cibernéticas.

A continuación ilustraremos el proceso de ataque de un malware inteligente:

Robo de datos

Las bases de datos son el blanco de muchos ciberatacantes que comprometen la ciberseguridad de las empresas.

A través de los algoritmos de la IA es posible extraer datos sensibles precisa y eficientemente de manera automática.

Esta táctica puede ser utilizada por medio de explotación de vulnerabilidades, donde imitan patrones de tráfico, se vuelven invisibles a la detección y extraen información confidencial.

Fraude

El fraude es un engaño ejecutado a través de contenidos audiovisuales realizados por inteligencia artificial, con el fin de transgredir la ciberseguridad. Estos contenidos incluyen generación de texto, creación de imágenes y videos falsos, e incluso replicación de voz.

Esta estafa se realiza principalmente a través de PNL (Procesamiento de Lenguaje Natural) que es un atributo de las IA que les permite entender, interpretar y generar un diálogo humanizado, lo cual es útil para manipular, engañar a las personas y obtener datos confidenciales o simplemente convencerlas de la veracidad de determinada información.

Romper sistemas de seguridad

Las funciones generativas de IA pueden quebrar los sistemas de seguridad, pues tienen la capacidad de adivinar contraseñas y superar medidas de captcha.

Los ataques con AI presentan un desafío para la ciberseguridad ya que, a través de los modelos de generación de texto, es posible producir secuencias de texto que imiten patrones comunes de contraseñas.

En cuanto al captcha, la IA es capaz de replicar el comportamiento humano y generar respuestas para su resolución, lo cual evade las medidas de seguridad.

Esto plantea un desafío adicional en la protección contra accesos no autorizados, ya que la capacidad de la IA para sortear sistemas de verificación representa una amenaza potencial para la integridad de los mecanismos de seguridad implementados.

Desafíos de la IA en la ciberseguridad

Hemos revisado la importancia de la IA en la ciberseguridad de las empresas y la relevancia que esta tiene también en las nuevas tácticas de los ciberatacantes.

Ahora es momento de revisar cómo lograr que la ciberseguridad sea más inteligente que los ciberataques que pueda enfrentar. Dicho de otro modo, prevenir un ataque hacia la herramienta que nos está protegiendo, es decir, un ataque a la IA de ciberseguridad.

Ataques a la IA

La inteligencia artificial debe ser considerada como una ampliación de la superficie de riesgo, al igual que cualquier otro sistema digital, se encuentra en peligro de ser atacada, y estos ataques se realizan a través de diferentes mecanismos.

La extracción de datos es uno de ellos. Al introducirse en la IA el atacante puede observar cómo funciona su algoritmo de ciberseguridad y a partir del comportamiento documentado, extraer los parámetros de su funcionamiento y facilitar su ofensiva.

Otro mecanismo de ataque es la manipulación de datos. Las IA en la ciberseguridad son configuradas y programadas con un código que les permite emplear sus funciones de manera efectiva, sin embargo si estas se manipulan, su operatividad se configurará a favor del atacante. La manipulación de datos puede verse de dos formas: inyección e inversión.

Una inyección de datos, inserta en el código parámetros diferentes y erróneos que conflictúan o modifican la configuración y orden del entrenamiento de la IA. Puede servir para impedir que la IA de ciberseguridad funcione e infiltrarse con mayor facilidad.

La inversión de datos, por su parte, se dedica a darle nuevas órdenes al código y entrenar al modelo de IA para permitir o desatender amenazas a la ciberseguridad.

Además del código, uno de los elementos más importantes de las IA en la ciberseguridad es su algoritmo, pues este les indica cómo reaccionar a los estímulos. Al corromperlo alteran su proceso de aprendizaje, y podría llevar a que la inteligencia realice acciones maliciosas.

Los atacantes diseñan datos confusos que conducen a la IA a tomar decisiones erróneas y comprometer los activos de la empresa.

Medidas de prevención para usar la IA en la ciberseguridad

La integración creciente de la IA en la ciberseguridad ha abierto nuevas posibilidades para fortalecer las defensas contra amenazas digitales.

Sin embargo, esta evolución también ha planteado desafíos significativos. En este contexto, exploraremos medidas de prevención cruciales destinadas a garantizar un uso seguro y efectivo de la IA en ciberseguridad.

Diseño de la IA para la ciberseguridad

La cultura de ciberseguridad sobre la IA, que va a auxiliar en el cuidado de la seguridad cibernética empresarial, es sustancial para prevenir incidentes.

Por ejemplo, si una IA en la ciberseguridad está entrenada para reconocer patrones de comportamiento malicioso en la red y un atacante introduce datos de entrada engañosos de manera sutil para confundirla, puede simular actividades normales u ocultar patrones maliciosos.

El objetivo sería comprometer la eficacia de la IA en la detección y prevención de amenazas, debilitando así las defensas cibernéticas de la organización.

Por eso, desde que una IA en la ciberseguridad es diseñada, debe tomarse en cuenta que el modelo sea desarrollado con medidas de protección, para disminuir la vulnerabilidad y el peligro de ataque.

Un diseño de IA en la ciberseguridad implica la implementación de medidas y prácticas que garanticen la robustez, confidencialidad, integridad y disponibilidad, así como la protección contra posibles amenazas y riesgos

Una IA comprensible para una ciberseguridad robusta

Para que los encargados de ciberseguridad puedan hacer uso efectivo de la IA que complementará su trabajo, es importante que estos entiendan el funcionamiento del algoritmo y su toma de decisiones.

Una IA en la ciberseguridad clara y comprensible, que sea transparente en sus objetivos o provea de herramientas de interpretación, brinda mayor confianza y facilita la identificación y corrección de posibles descuidos.

Pruebas de calidad sobre la Inteligencia Artificial

Para prevenir un posible ataque, es necesario que se evalúe si la IA en la ciberseguridad contiene propiedades que le permitan tener un buen funcionamiento, y que la hagan operar correctamente.

Estas pruebas se pueden realizar con tests de penetración, en donde se haga un análisis para conocer si existe alguna vulnerabilidad y corregirla a partir de los datos recabados, para así tener modelos, aplicaciones y sistemas más seguros y mitigar los posibles riesgos.

Exceder la confianza en la IA=Ciber Exposición

Si bien se busca que los sistemas de IA en la ciberseguridad brinden confiabilidad en sus funciones, nunca está de más mantener una supervisión humana activa que administre y verifique el buen funcionamiento del modelo.

Si se deja todo en manos de la IA, la ciber exposición será mayor, por lo que se recomienda que no haya una dependencia excesiva hacia la misma.

DevSecOps: ciberseguridad en equipo

Los DevSecOps son una estrategia de defensa en equipo. La ciberseguridad debe tener un grupo de expertos, robusto, que la respalde la protección. Idealmente este equipo debe estar conformado por un ingeniero de seguridad, un analista de seguridad, un especialista en infraestructura, un desarrollador de software y un técnico en automatización.

DevSecOps significa en español, desarrollo de operaciones segura, y proviene de DevOps (Development Operation), que también gira en torno a la optimización de procedimientos y está conformado por miembros multidisciplinares capaces de gestionar soluciones de software y eliminar las ineficiencias que pudiera llegar a tener.

Los DevSecOps deben desarrollar una estrategia defensiva integral que cubra diferentes aspectos, asegurándose de no descuidar ninguno de los siguientes puntos.

- Limitar accesos al código y algoritmo de la IA, para evitar exposición de los mismos.

- Comprender el modelo IA en la ciberseguridad e identificar sus puntos fuertes y débiles.

- Insertar una protección contra la inserción de sesgos maliciosos y explotación de vulnerabilidades.

- Desarrollar capacidades de detección de intrusos y mitigación de ataques

- Evaluar continuamente la necesidad de actualizaciones y parches de seguridad.

Trazabilidad para una ciberseguridad infalible

Si la IA en la ciberseguridad llega a tener fallos, es necesario que estos se rastreen y analicen oportunamente, investigar el motivo de los mismos y tomar medidas para que estos errores no se repliquen en el futuro. A esta estrategia se le llama trazabilidad.

Conclusión

2024 es un año que incluye y exige a la inteligencia artificial en la digitalización empresarial, desaprovechar esta tecnología significaría rezagarse en el mercado y por lo tanto no hacer frente a la competencia. Las organizaciones deben reforzar sus sistemas con IA en la ciberseguridad, pues hoy en día ambas son parte inherente de la tecnología.

La investigación, el desarrollo y la información (I+D+i) necesita coordinarse con las estrategias de la IA en la ciberseguridad para desarrollar procedimientos e implementaciones que cuiden el diseño y desarrollo de los sistemas, así como la integridad de la información.

Aún se continúa trabajando en el progreso de la IA, en términos de análisis y toma de decisiones instantáneos para descubrir y responder a ataques cibernéticos, pero al realizar inversiones en ella, las organizaciones pueden explotar su potencial en ciberseguridad.

Es cierto que con el creciente uso de las tecnologías, las empresas han aumentado su almacenamiento de datos críticos en línea y por lo tanto se ha incrementado su exposición, pero a pesar de los desafíos, es importante aprovechar las oportunidades que nos brinda la la IA en la ciberseguridad de las empresas para integrar medidas de protección sólidas y transformadoras.